Anthropic ฟ้องรัฐบาลสหรัฐฯ หลังถูกมองเป็นภัยความมั่นคง ปม AI เพื่อการทหาร

บริษัท AI ชั้นนำอย่าง Anthropic กำลังเผชิญหน้าทางกฎหมายกับรัฐบาลสหรัฐอเมริกา หลังจากถูกระบุว่าเป็นภัยต่อความมั่นคงของชาติ ซึ่งเป็นประเด็นที่จุดชนวนคำถามสำคัญเกี่ยวกับขอบเขตการใช้ปัญญาประดิษฐ์ในกิจการทหาร

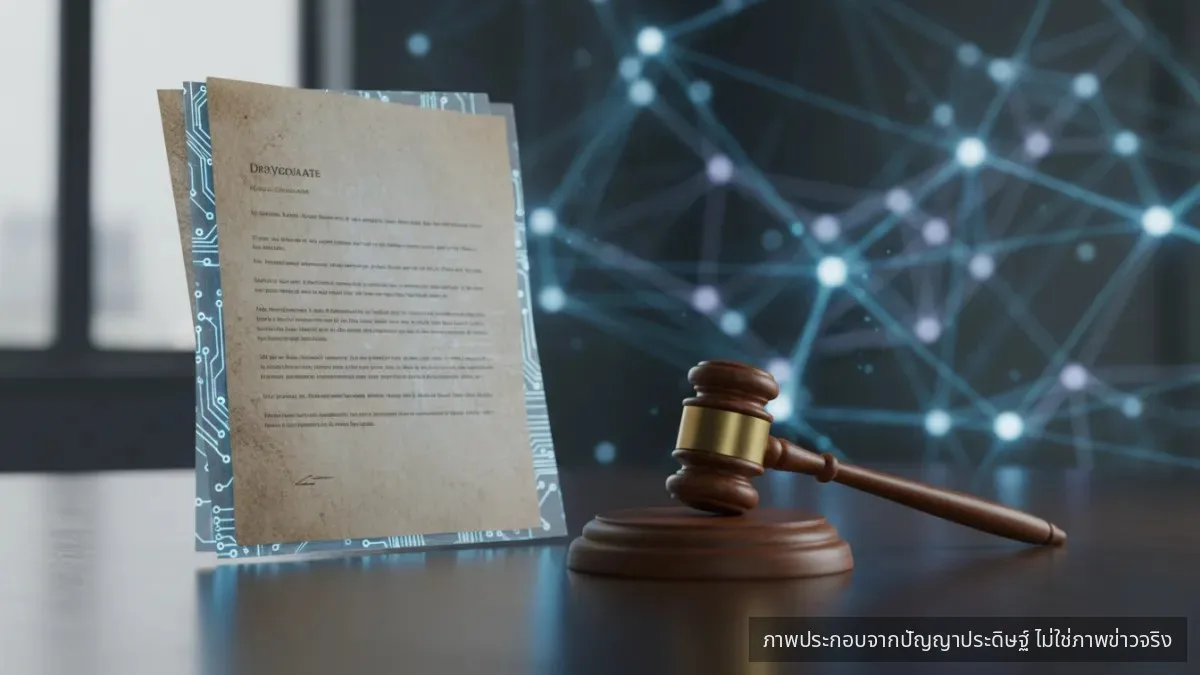

Anthropic ฟ้องรัฐบาลสหรัฐฯ หลังกระทรวงกลาโหมชี้เป็น ‘ความเสี่ยงที่ยอมรับไม่ได้’ ต่อความมั่นคง จากการปฏิเสธเงื่อนไขใช้ AI เพื่อการทหารและสอดแนมมวลชน

จับประเด็นสำคัญ

- กระทรวงกลาโหมสหรัฐฯ ระบุว่า Anthropic เป็น “ความเสี่ยงที่ยอมรับไม่ได้” ต่อความมั่นคงแห่งชาติ

- Anthropic ยื่นฟ้องรัฐบาลเพื่อคัดค้านการถูกขึ้นบัญชีความเสี่ยง หลังปฏิเสธเงื่อนไขการใช้ AI พัฒนาอาวุธและสอดแนมมวลชน

- บริษัทเทคโนโลยียักษ์ใหญ่อย่าง Microsoft, Google และ OpenAI ได้ยื่นเอกสารสนับสนุนการฟ้องร้องของ Anthropic

มันหมายความว่าอะไรกับคนใช้จริง

เหตุการณ์นี้ไม่ใช่เรื่องของผลิตภัณฑ์ AI ที่ผู้ใช้ทั่วไปสัมผัสโดยตรง แต่เป็นภาพสะท้อนความขัดแย้งเชิงนโยบายและจริยธรรมครั้งสำคัญระหว่างผู้พัฒนา AI กับภาครัฐ ประเด็นหลักคือ บริษัทเทคโนโลยีต้องการขีดเส้นแบ่งทางจริยธรรม (corporate red lines) เพื่อไม่ให้เทคโนโลยีของตนถูกนำไปใช้ในทางที่อาจเป็นอันตราย เช่น อาวุธอัตโนมัติ ในขณะที่รัฐบาลต้องการสิทธิ์ในการใช้เทคโนโลยีเพื่อวัตถุประสงค์ใดๆ ก็ตามที่ถูกกฎหมายเพื่อความมั่นคงของชาติ ความขัดแย้งนี้อาจส่งผลต่อทิศทางการพัฒนาและความร่วมมือระหว่างภาครัฐและเอกชนในอุตสาหกรรม AI ในระยะยาว

สิ่งที่ต้องจับตาต่อ (What to watch)

- ผลการพิจารณาของศาลต่อคำร้องขอคำสั่งคุ้มครองชั่วคราวของ Anthropic เพื่อระงับคำสั่งแบนของรัฐบาล

- ความคืบหน้าของคดีความหลักที่ Anthropic ต้องการเพิกถอนการถูกระบุว่าเป็น ‘ความเสี่ยงด้านซัพพลายเชน’

- ท่าทีของบริษัท AI อื่นๆ ว่าจะกำหนดเงื่อนไขการใช้งานเทคโนโลยีของตนกับหน่วยงานภาครัฐอย่างไรในอนาคต

เหตุผลเบื้องลึกของกระทรวงกลาโหม

ในเอกสารที่ยื่นต่อศาล กระทรวงกลาโหมสหรัฐฯ (หรือที่หน่วยงานเรียกว่า Department of War) อธิบายว่าความกังวลหลักเกิดจากการที่ Anthropic ปฏิเสธข้อสัญญาที่อนุญาตให้หน่วยงานสามารถใช้เทคโนโลยี AI เพื่อวัตถุประสงค์ใดๆ ที่ชอบด้วยกฎหมายได้ ทางเพนตากอนมองว่าพฤติกรรมนี้ทำให้เกิดคำถามถึงความน่าเชื่อถือของ Anthropic ในฐานะ ‘พันธมิตรที่ไว้ใจได้’ สำหรับโครงการที่มีความอ่อนไหวสูง

ความกลัวที่ใหญ่ที่สุดของกระทรวงกลาโหมคือ Anthropic อาจพยายามปิดการใช้งานหรือเปลี่ยนแปลงการทำงานของโมเดล AI ของตนเองได้ หากบริษัทรู้สึกว่ารัฐบาลกำลังนำเทคโนโลยีไปใช้ในทางที่ขัดต่อหลักการของบริษัท ซึ่งถือเป็นความเสี่ยงที่ยอมรับไม่ได้ต่อความมั่นคงของชาติ โดยเฉพาะอย่างยิ่งระหว่างปฏิบัติการทางทหาร

ผลกระทบต่อธุรกิจ และแรงสนับสนุนจากวงการเทคฯ

แม้ว่าคำสั่งแบนจะส่งผลเฉพาะกับหน่วยงานรัฐบาลกลาง แต่การถูกตีตราว่าเป็น ‘ความเสี่ยงด้านซัพพลายเชน’ อาจสร้างความเสียหายต่อชื่อเสียงและธุรกิจของ Anthropic อย่างมหาศาล บริษัทระบุว่าอาจทำให้สูญเสียรายได้หลายพันล้านดอลลาร์ อย่างไรก็ตาม Anthropic ไม่ได้ต่อสู้อย่างโดดเดี่ยว เมื่อบริษัทยักษ์ใหญ่ในวงการอย่าง Microsoft, Google และ OpenAI ได้ยื่นเอกสารแสดงความเห็นต่อศาล (friend-of-the-court briefs) เพื่อสนับสนุนคำร้องของ Anthropic ซึ่งสะท้อนให้เห็นว่าประเด็นนี้มีความสำคัญต่อทั้งอุตสาหกรรมเทคโนโลยี

แกนของเรื่องคือ “ข้อเท็จจริงหลัก” ที่ต้นทางยืนยันแล้ว ส่วนผลลัพธ์การใช้งานขึ้นอยู่กับเงื่อนไขที่ระบุไว้

ตารางตรวจสอบข้อเท็จจริง (Fact-Check)

| ประเด็น | ข้อมูลจากแหล่งข่าว | ผลตรวจสอบของ AI | สถานะ |

|---|---|---|---|

| การระบุความเสี่ยงของ Anthropic | DoD ระบุว่า Anthropic ก่อให้เกิด ‘ความเสี่ยงที่ยอมรับไม่ได้’ (unacceptable risk) ต่อความมั่นคงแห่งชาติ | เนื้อหาระบุตรงตามที่แหล่งข่าวอ้างอิงถึงคำในเอกสารยื่นฟ้องของกระทรวงกลาโหม | ตรง |

| ชื่อบริษัทและหน่วยงานที่เกี่ยวข้อง | Anthropic, Department of Defense, Microsoft, Google, OpenAI | คัดลอกชื่อเฉพาะตามต้นฉบับภาษาอังกฤษ ไม่มีการแปลหรือเปลี่ยนแปลง | ตรง |

| ผลกระทบทางการเงินที่อาจเกิดขึ้น | อาจสูญเสียรายได้หลายพันล้านดอลลาร์ (billions of dollars) | ยืนยันว่าใช้ข้อมูลผลกระทบทางการเงินตามที่ระบุในแหล่งข่าว ไม่มีการระบุตัวเลขที่แน่นอน | ตรง |

| การดำเนินการทางกฎหมายของ Anthropic | บริษัทกำลังยื่นขอคำสั่งคุ้มครองชั่วคราว (preliminary injunction) | ระบุถึงขั้นตอนทางกฎหมายที่กำลังดำเนินอยู่ตามที่แหล่งข่าวรายงาน | ตรง |

อ่านเพิ่ม

Reference Site: Engadget